Uzmanlar, Kapıdaki Otonom Silah Tehlikesi İçin BM'yi Uyardı: 'Pandora'nın Kutusu Açılırsa Kapatmak Zor Olur'

Uzmanlar, Kapıdaki Otonom Silah Tehlikesi İçin BM'yi Uyardı: 'Pandora'nın Kutusu Açılırsa Kapatmak Zor Olur'

Ülkemizde kendisine pek vakit ayrılmasa da dünyada birçok tartışmaya neden olan konulardan biri yapay zeka. Dönen tartışmalar ışığında ne olup bittiğini anlamlandırmaya çalışırken bir grup yapay zeka uzmanı gerekli önlemlemlerin alınması hususunda Birleşmiş Milletler'e bir mektup yazarak uyarıda bulundu: 'Pandora'nın kutusu açılırsa kapatması zor olur.'

Yapay zeka ile ilgili dönem dönem açıklama yapan kişilerin başında ünlü fizikçi Stephen Hawking geliyor.

Fakat insanlık için iyi veya kötü sonuçlar doğurabileceği konusunda emin değil. Açıklamalarına göre yapay zeka insanlığın başına gelen en iyi şey de en kötü şey de olabilir.

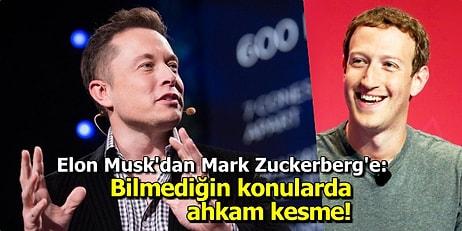

Yapay zeka yakın zamanda Elon Musk ve Mark Zuckerberg tarafından farklı açılardan yorumlanmış ve ikili arasında minik bir tartışmaya dönüşmüştü.

Bugün ise yapay zekanın sınırlandırılması adına yeni bir adım atıldı.

26 ülkeden 116 yapay zeka uzmanı Birleşmiş Milletler'e mektup yazarak bir talepte bulundu: 'Öldürme yeteneği olan robotların geliştirilmesi ve kullanılması yasaklansın!'

İmzacılar arasında Tesla CEO'su Elon Musk ve Google'ın satın aldığı yapay zeka şirketi DeepMind'ın kurucusu Mustafa Süleyman da yer alıyor.

BBC Türkçe'nin Guardian gazetesine dayandırdığı habere göre Birleşmiş Milletler zaten kısa süre önce otonom silahlar üzerine bir oturum yapma kararı almıştı.

'Pandora'nın kutusu bir kere açıldıktan sonra kapatması zor olur'

Uzmanların kaleme aldığı açık mektupta şu ifadeler yer aldı:

'Geliştirilmeleri durumunda otonom silahlar, savaşların daha önce eşi benzeri görülmemiş bir ölçüde, insanların kavrayabileceği hızdan kat kat daha hızlı gelişmesine yol açacaktır. Bu silahlar teröristler veya despotlar tarafından kullanılabileceği gibi hacklenmeye de müsait olacaktır. Harekete geçmek için çok zamanımız yok. Pandora'nın kutusu bir kere açıldıktan sonra onu kapatması zor olacak.'

Elbette ihtimaller dahilinde kötü bir durumla karşılaşılması mümkün fakat yapay zeka profesörü Toby Walsh öncelikle 'Hangi türden bir gelecek istiyoruz?' sorusunun cevabını bulmamız gerektiği kanısında.

Gazeteye konuşan Sydney'deki New South Wales Üniversitesi'nden yapay zeka profesörü Toby Walsh, yapay zekanın da diğer teknolojiler gibi iyi veya kötü amaçlar için kullanılabileceğini söylüyor:

'Yapay zeka eşitsizliği ve yoksulluğu yok etmek, iklim değişikliği ve küresel finansal krizin getirdiği sorunlarla başa çıkmak için kullanılabilir. Ama aynı teknoloji otonom silahlarla savaşları endüstriyelleştirmek için de kullanılabilir. Hangi türden bir gelecek istediğimize karar vermemiz gerekiyor.'

Öte yandan birçok ülke bu teknolojiyi savaş endüstrisinde kullanmaya başladı.

Güney Kore şirketi Samsung, ülkenin Kuzey Kore sınırına otonom bir silah yerleştirdi bile.

SGR-A1 adlı sabit silah, otonom bir şekilde hedef tespit edip ateş etme yeteneğine sahip. Fakat sınırda bu özelliğin kullanılıp kullanılmayacağı konusu netleşmedi.

Silahın gözlem yapma, ses tanıma ve el bombası fırlatma özelliği de bulunuyor.

Samsung'un yanı sıra İngiltere'deki BAE Systems'in geliştirmekte olduğu Taranis adlı insansız hava aracı da otonom özelliklere sahip. Rusya ve ABD birer otonom tank projesi üzerinde çalışırken ABD'nin ayrıca otonom savaş gemisi de bulunuyor.

Keşfet ile ziyaret ettiğin tüm kategorileri tek akışta gör!

Yorum Yazın