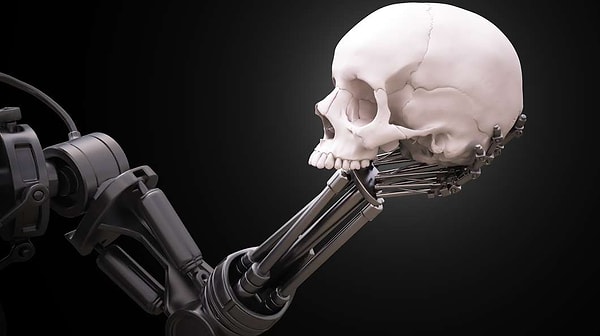

Bilim İnsanları 'Robot Savaşçılar'a Karşı Uyardı

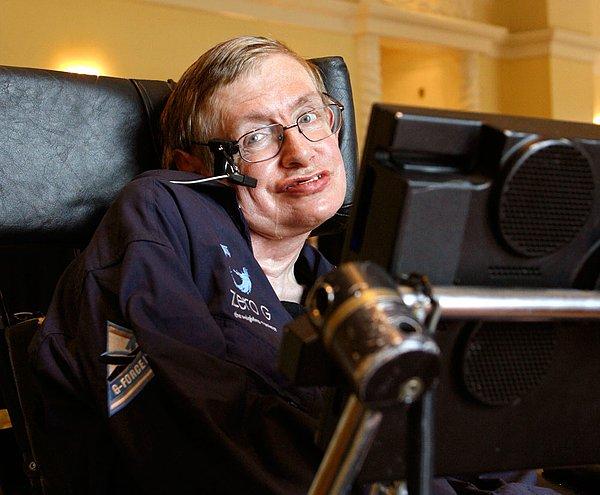

Stephen Hawking'in de aralarında bulunduğu bir grup bilim insanı, 'otonom silah sistemlerinin' ölümcül etkileri olabileceği konusunda uyarıda bulundu.

Aralarında ünlü İngiliz astrofizikçi Prof. Dr. Stephen Hawking de bulunduğu bine yakın bilim insanının imzasını taşıyan ortak mektup, Arjantin'in başkenti Buenos Aires'teki Uluslararası Yapay Zeka Konferansı'nda okundu.

Mektupta 'Hedef seçiminde hala insanlara bağlı olan seyir (cruise) füzeleri ve insansız hava araçlarından farklı olarak yapay zekayla kontrol edilen silahlar ya da katil robotlar, hedeflerini insanlarla doğrudan iletişim kurmadan seçip vuracak. Büyük bir askeri gücün otonom silahları geliştirmeye başlaması, korkunç sonuçlara yol açabilir' ifadeleri kullanıldı.

Otonom silahların barut ve nükleer silahların ardından savaş alanında 'üçüncü devrim' olarak nitelendiğine dikkat çekilen mektupta, 'Nükleer, kimyasal ya da biyolojik silahların aksine otonom silahlar, çok sayıda ve düşük maliyetle üretilebilecek. Bu silahlar, kolayca karaborsaya, oradan da terör örgütlerinin eline düşebilir. Dünyanın önde gelen askeri güçlerinden birinin otonom silah geliştirmeye başlamasının, küresel bir yarışa yol açması kaçınılmazdır. Bu durumda otonom silahlar, geleceğin kalaşnikofu haline gelecektir' denildi.

Otonom silahların suikastler, soykırım ve nüfus kontrolü gibi kitlesel ölümlere yol açacak eylemler için ideal seçenek olacağına işaret edilen mektupta, 'Dünyanın önde gelen askeri güçleri, otonom silah geliştirme yarışını daha başlamadan sona erdirmek zorundadır' ifadesine yer verildi.

İngiliz astrofizikçi Stephen Hawking ve SpaceX yöneticisi Elon Musk

Mektubu imzalayanlar arasında Apple'ın kurucularından Steve Wozniak, SpaceX şirketinin Üst Yöneticisi Elon Musk, DeepMind şirketinin kurucusu Demis Hassabis, filozof Noam Chomsky ve Google yöneticilerinden Peter Norvig de yer alıyor.

Mektup, Yaşamın Geleceği Enstitüsü'nün (Future of Life Institute - FLI) internet sitesinde de yayımlandı.

AA

Keşfet ile ziyaret ettiğin tüm kategorileri tek akışta gör!